Di balik kesuksesan website besar yang terus mendominasi halaman pertama Google, ada satu faktor teknis yang sering luput diperhatikan pemilik situs kecil dan menengah, yaitu crawl budget maksimal. Istilah ini mungkin terdengar sangat teknis, namun pengaruhnya terhadap visibilitas dan trafik organik sebuah website sangat nyata. Mesin pencari seperti Google bekerja dengan sumber daya terbatas, sehingga mereka harus memilih seberapa sering dan seberapa banyak halaman di satu website akan dirayapi dalam periode tertentu. Di titik inilah permainan sebenarnya dimulai.

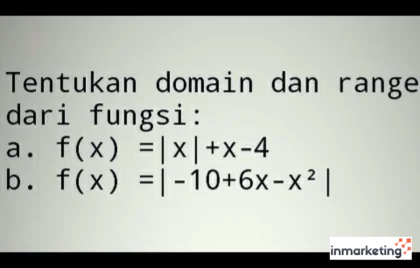

Mengapa Crawl Budget Maksimal Jadi Senjata Rahasia Website Besar

Banyak pemilik website hanya fokus pada konten dan backlink, tanpa menyadari bahwa Google tidak serta merta merayapi semua halaman mereka. Crawl budget maksimal menentukan seberapa intens robot Googlebot akan mengunjungi situs Anda. Semakin efisien penggunaan anggaran perayapan ini, semakin besar peluang halaman baru dan penting muncul lebih cepat di hasil pencarian.

Website besar seperti portal berita, marketplace, dan direktori memiliki ribuan hingga jutaan halaman. Jika crawl budget mereka berantakan, Google akan menghabiskan waktu di halaman yang tidak penting, sementara halaman strategis yang berpotensi mendatangkan trafik justru terlambat terindeks.

> “Bukan hanya jumlah halaman yang menentukan kekuatan sebuah website di Google, tetapi seberapa cerdas website itu mengarahkan Googlebot ke halaman yang tepat pada waktu yang tepat.”

Cara Kerja Google Menentukan Crawl Budget Maksimal

Sebelum mengoptimasi, perlu memahami bagaimana Google sebenarnya memutuskan berapa banyak dan seberapa sering halaman Anda dirayapi. Ada dua konsep besar yang sering disebut dalam dokumentasi resmi Google: crawl rate limit dan crawl demand. Keduanya saling terkait dan berujung pada terbentuknya crawl budget maksimal untuk sebuah domain.

Faktor Teknis yang Mempengaruhi Crawl Budget Maksimal

Crawl budget maksimal bukan angka yang terlihat langsung di Search Console, tetapi bisa diraba dari perilaku Googlebot terhadap situs Anda. Secara teknis, ada beberapa faktor kunci yang sering menjadi penentu.

# Kecepatan Server dan Respons Situs

Semakin cepat server merespons, semakin nyaman Googlebot merayapi situs Anda. Jika server lambat atau sering error, Google akan otomatis menurunkan intensitas perayapan agar tidak membebani server.

– Waktu muat halaman yang tinggi membuat Google mengurangi jumlah halaman yang dirayapi per sesi.

– Error server 5xx yang sering terjadi memberi sinyal bahwa situs tidak siap menerima banyak kunjungan bot.

– Penggunaan hosting murah tanpa optimasi sering menjadi penghambat diam-diam bagi crawl budget maksimal.

# Popularitas dan Permintaan Konten

Google cenderung memberikan porsi crawl lebih besar pada website yang kontennya sering diakses pengguna dan sering diperbarui. Portal berita nasional, misalnya, bisa mengalami perayapan sangat intens karena banyak halaman mereka diakses dan diupdate setiap menit.

Sementara itu, blog kecil yang jarang update dan tidak punya banyak backlink akan mendapatkan porsi crawl yang jauh lebih kecil. Ini bukan diskriminasi, melainkan strategi efisiensi Google dalam mengalokasikan sumber daya.

# Struktur URL dan Kualitas Internal Linking

Struktur URL yang rapi membantu Google memahami hierarki konten. Jika internal linking berantakan dan banyak halaman terisolasi, Googlebot akan kesulitan menemukan dan memprioritaskan halaman penting.

Crawl budget maksimal bisa terbuang sia sia jika:

– Terlalu banyak URL duplikat karena parameter

– Banyak halaman tipis konten dengan nilai rendah

– Ada loop navigasi yang membuat Googlebot berputar di area yang sama

Masalah Umum yang Menguras Crawl Budget Maksimal

Banyak pemilik website tidak menyadari bahwa mereka sendiri yang menghabiskan crawl budget maksimal dengan sia sia. Hal ini biasanya muncul karena pengelolaan teknis yang kurang rapi, terutama saat skala website mulai membesar.

Halaman Duplikat dan Parameter URL yang Tidak Terkontrol

Duplikasi konten adalah pembunuh senyap bagi efisiensi perayapan. Misalnya, sebuah produk di e commerce bisa diakses melalui banyak kombinasi parameter seperti sort, filter, atau tracking. Bagi Google, ini bisa terlihat sebagai banyak URL berbeda meski kontennya serupa.

Jika tidak dikendalikan, Googlebot akan menghabiskan waktu merayapi ratusan URL variasi yang sebenarnya tidak memberikan nilai tambahan. Akibatnya, halaman penting lain yang unik dan bernilai justru tertunda untuk dirayapi.

Konten Tipis dan Halaman Berkualitas Rendah

Halaman dengan konten sangat pendek, hampir tanpa informasi, atau hanya berisi duplikasi kalimat standar sering kali dianggap berkualitas rendah. Jika jumlahnya banyak, Google akan menilai bahwa sebagian besar halaman di situs tersebut tidak layak mendapatkan perhatian besar.

Ini bisa menurunkan efektivitas crawl budget maksimal, karena Googlebot akan semakin selektif dan memperlambat frekuensi perayapan. Website katalog, direktori, atau listing sering jatuh ke jebakan ini jika tidak mengelola kualitas konten per halaman.

Error Teknis yang Terus Dibiarkan

Error 404, redirect chain yang terlalu panjang, hingga halaman yang terus menerus mengembalikan status 500 akan membuat Googlebot “membuang waktu” ke URL yang tidak memberikan hasil. Jika ini berlangsung lama, Google akan mengurangi intensitas crawl.

> “Setiap error yang dibiarkan berlarut larut ibarat memasang rambu ‘jangan sering ke sini’ untuk Googlebot, dan itu bisa memengaruhi seluruh situs, bukan hanya satu halaman.”

Strategi Mengoptimalkan Crawl Budget Maksimal di Website Besar

Setelah memahami masalahnya, fokus berikutnya adalah menyusun strategi konkret. Website besar membutuhkan pendekatan sistematis, bukan sekadar perbaikan kecil di sana sini. Optimasi crawl budget maksimal harus menjadi bagian dari manajemen teknis harian.

Menggunakan Robots.txt dan Noindex dengan Cerdas

File robots.txt dan meta tag noindex adalah dua alat utama untuk mengarahkan Googlebot. Keduanya perlu digunakan secara hati hati, karena salah konfigurasi bisa membuat halaman penting hilang dari indeks.

# Mengatur Area yang Tidak Perlu Dirayapi

Beberapa area di website sebenarnya tidak perlu sering dirayapi, atau bahkan tidak perlu dirayapi sama sekali, misalnya:

– Halaman hasil pencarian internal

– Halaman filter dengan kombinasi parameter tak terbatas

– Halaman login, keranjang belanja, atau profil pribadi

Dengan mengatur disallow di robots.txt dan menerapkan noindex di halaman yang tidak perlu muncul di hasil pencarian, Anda bisa menghemat crawl budget maksimal untuk halaman yang benar benar penting.

# Menghindari Pemblokiran Berlebihan

Meski menghemat crawl itu penting, pemblokiran berlebihan bisa berbalik merugikan. Misalnya, memblokir seluruh folder yang ternyata berisi halaman kategori utama. Google tidak bisa merayapi dan menilai halaman tersebut, sehingga mereka tidak akan tampil maksimal di hasil pencarian.

Keseimbangan antara efisiensi dan aksesibilitas menjadi kunci. Setiap perubahan di robots.txt sebaiknya diuji dan dipantau melalui Google Search Console.

Memperkuat Internal Linking dan Struktur Konten

Internal linking yang kuat adalah peta jalan bagi Googlebot. Semakin jelas struktur navigasi, semakin mudah Google menentukan prioritas halaman mana yang perlu sering dirayapi.

# Menentukan Halaman Pilar dan Halaman Pendukung

Di website besar, tidak semua halaman memiliki nilai strategis yang sama. Anda perlu menentukan:

– Halaman pilar yang menjadi pusat tema besar

– Halaman pendukung yang mengulas topik lebih spesifik

– Halaman transaksional yang langsung mengarah ke konversi

Dengan menempatkan lebih banyak tautan internal ke halaman pilar dan halaman bernilai tinggi, Anda memberi sinyal kepada Google bahwa halaman tersebut layak mendapatkan porsi crawl budget maksimal yang lebih besar.

# Menghindari Halaman Yatim

Halaman yatim adalah halaman yang tidak memiliki tautan internal dari halaman lain. Walaupun secara teknis bisa ditemukan lewat sitemap, halaman seperti ini sering mendapatkan prioritas rendah. Di website besar, audit berkala untuk menemukan dan menghubungkan halaman yatim menjadi langkah penting agar crawl budget tidak terbuang percuma di struktur yang buntu.

Peran Sitemap dan Log Server dalam Mengawal Crawl Budget Maksimal

Di balik layar, ada dua alat analisis yang sering digunakan tim teknis di website besar untuk memantau perilaku Googlebot dan mengarahkan crawl budget maksimal secara lebih presisi.

Sitemap XML yang Terstruktur dan Tersegmen

Sitemap bukan sekadar daftar URL, tetapi juga alat komunikasi dengan Google mengenai mana halaman yang paling penting dan terbaru. Untuk website besar, satu sitemap raksasa tidak lagi cukup.

# Membagi Sitemap Berdasarkan Tipe Konten

Pendekatan yang umum dilakukan:

– Sitemap khusus artikel atau berita

– Sitemap khusus produk atau listing

– Sitemap khusus halaman kategori utama

Dengan cara ini, Anda bisa memantau secara lebih spesifik mana area yang sering dirayapi dan mana yang tertinggal. Pembaruan sitemap secara berkala juga membantu Googlebot memfokuskan perayapan pada konten terbaru yang layak mendapat perhatian.

Analisis Log Server untuk Melihat Pola Perayapan

Log server menyimpan catatan setiap kunjungan, termasuk kunjungan Googlebot. Dari sini, Anda bisa melihat:

– URL mana yang paling sering dirayapi

– Area mana yang hampir tidak pernah disentuh

– Waktu dan frekuensi kunjungan per bagian situs

Banyak tim SEO teknis di website besar menggunakan analisis log untuk menemukan pemborosan crawl budget maksimal, misalnya ketika Googlebot terlalu sering merayapi halaman yang tidak penting atau halaman yang sudah lama dialihkan.

Dengan memahami pola ini, Anda bisa melakukan penyesuaian teknis seperti mengubah struktur internal link, memperbarui sitemap, atau menyesuaikan aturan di robots.txt agar Googlebot diarahkan ke halaman yang benar benar bernilai bagi strategi bisnis dan konten Anda.

Comment